Napisane przez 0xjacobzhao | https://linktr.ee/0xjacobzhao

W naszym czerwcowym raporcie „Święty Graal Crypto AI: Wstępne Badania Zdecentralizowanego Szkolenia” omówiliśmy Uczenie Federacyjne—paradygmat „kontrolowanej decentralizacji” umiejscowiony pomiędzy szkoleniem rozproszonym a w pełni zdecentralizowanym. Jego podstawowa zasada to utrzymywanie danych lokalnie, podczas gdy parametry są agregowane centralnie, co jest szczególnie odpowiednie dla branż wrażliwych na prywatność i obciążonych regulacjami, takich jak opieka zdrowotna i finanse.

Jednocześnie nasze wcześniejsze badania konsekwentnie podkreślały wzrost sieci agentów. Ich wartość polega na umożliwieniu realizacji złożonych zadań poprzez autonomiczną współpracę i podział pracy między wieloma agentami, przyspieszając przejście z "dużych monolitycznych modeli" w kierunku "ekosystemów wieloagentowych."

Uczenie federacyjne, z jego podstawami lokalnego przechowywania danych, zachęt opartych na wkładzie, rozproszonego projektowania, przejrzystych nagród, ochrony prywatności i zgodności z przepisami, położyło ważne podstawy dla współpracy wielu stron. Te same zasady mogą być bezpośrednio dostosowane do rozwoju sieci agentów. Zespół FedML podążał za tą trajektorią: ewoluując od otwartych źródeł do TensorOpera (warstwa infrastruktury AI dla przemysłu), a następnie dalej do ChainOpera (zdecentralizowana sieć agentów).

Niemniej jednak, Sieci Agentów nie są po prostu nieuchronnym rozszerzeniem Uczenia Federacyjnego. Ich istota leży w autonomicznej współpracy i specjalizacji zadań wśród agentów, a także można je budować bezpośrednio na podstawie Systemów Wieloagentowych (MAS), Uczenia przez Wzmocnienie (RL) lub mechanizmów zachęt opartych na blockchainie.

I. Uczenie Federacyjne i Stos Technologii Agentów AI

Uczenie federacyjne (FL) to ramy dla współpracy w treningu bez centralizacji danych. Jego podstawowa zasada polega na tym, że każdy uczestnik trenuje model lokalnie i przesyła tylko parametry lub gradienty do serwera koordynującego w celu agregacji, zapewniając tym samym, że "dane pozostają w swojej dziedzinie" i spełniając wymagania dotyczące prywatności i zgodności.

Po przetestowaniu w sektorach takich jak opieka zdrowotna, finanse i aplikacje mobilne, FL wszedł w stosunkowo dojrzały etap komercjalizacji. Jednak nadal stoi przed wyzwaniami, takimi jak wysokie koszty komunikacji, niepełne gwarancje prywatności i wąskie gardła wydajności spowodowane heterogenicznymi urządzeniami.

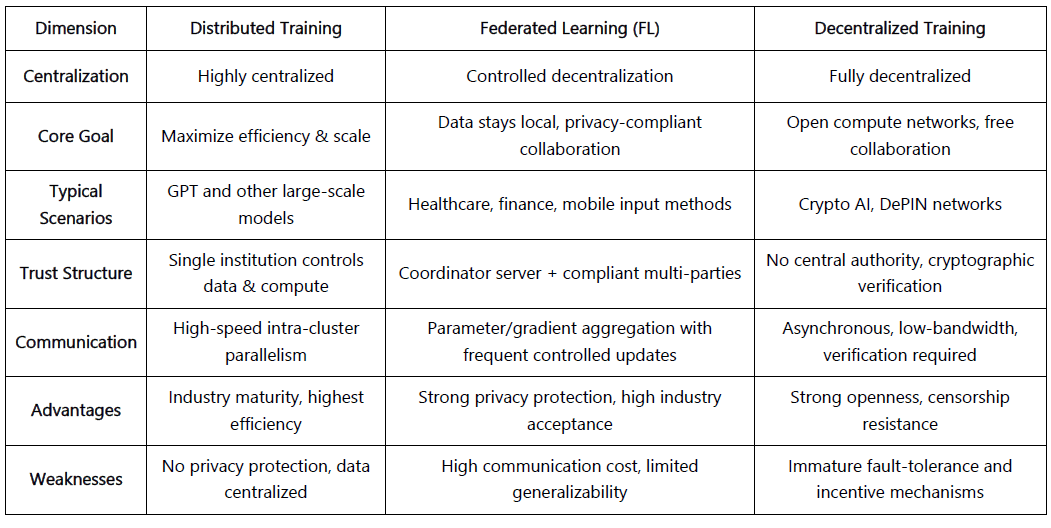

W porównaniu z innymi paradygmatami treningowymi:

Rozproszone uczenie podkreśla zcentralizowane klastry obliczeniowe, aby zmaksymalizować efektywność i skalę.

Zdecentralizowane uczenie osiąga w pełni rozproszoną współpracę za pośrednictwem otwartych sieci obliczeniowych.

Uczenie federacyjne leży pośrodku, funkcjonując jako forma "kontrolowanej decentralizacji": spełnia wymagania przemysłowe dotyczące prywatności i zgodności, jednocześnie umożliwiając współpracę między instytucjami, co czyni go bardziej odpowiednim jako przejściową architekturę wdrożeniową.

Stos Protokołów Agentów AI

W naszych wcześniejszych badaniach, sklasyfikowaliśmy stos protokołów Agentów AI na trzy główne warstwy:

1. Warstwa Infrastruktury (Warstwa Infrastruktury Agenta)

Fundamentalne wsparcie runtime dla agentów, stanowiące techniczną podstawę wszystkich systemów agentów.

Moduły podstawowe:

Rama Agenta – środowisko rozwoju i uruchamiania dla agentów.

System Operacyjny Agenta – głębsze harmonogramowanie wielozadaniowe i modułowe uruchamianie, zapewniające zarządzanie cyklem życia dla agentów.

Moduły wspierające:

Agent DID (zdecentralizowana tożsamość)

Portfel Agenta & Abstrakcja (abstrakcja konta & wykonanie transakcji)

Płatność/Regulacja Agenta (możliwości płatności i regulacji)

2. Warstwa Koordynacji & Wykonania

Skupia się na współpracy agentów, harmonogramowaniu zadań i systemach zachęt — kluczowych do budowania zbiorowej inteligencji wśród agentów.

Orkiestracja Agentów: Centralna orkiestracja i zarządzanie cyklem życia, alokacja zadań i wykonanie workflow — odpowiednia dla kontrolowanych środowisk.

Swarms Agentów: Rozproszona struktura współpracy podkreślająca autonomię, podział pracy i odporną koordynację — odpowiednia dla złożonych, dynamicznych środowisk.

Warstwa Zachęt dla Agentów: Warstwa ekonomiczna sieci agentów, która motywuje programistów, wykonawców i walidatorów, zapewniając zrównoważony rozwój ekosystemu.

3. Warstwa Aplikacji i Dystrybucji

Obejmuje kanały dystrybucji, aplikacje dla użytkowników końcowych i produkty skierowane do konsumentów.

Podwarstwa Dystrybucji: Launchpady Agentów, Rynki Agentów, Sieci Pluginów Agentów

Podwarstwa Aplikacji: AgentFi, Aplikacje natywne Agenta, Agent jako Usługa

Podwarstwa Konsumencka: Agenci społecznościowi/konsumenccy, skoncentrowani na lekkich scenariuszach dla użytkowników końcowych

Podwarstwa Memów: Projekty "Agenta" napędzane hype'm, z niewielką rzeczywistą technologią lub zastosowaniem — głównie napędzane marketingiem.

II. Benchmark Uczenia Federacyjnego: FedML i Pełnostackowa Platforma TensorOpera

FedML to jedna z najwcześniejszych otwartoźródłowych ram dla Uczenia Federacyjnego (FL) i rozproszonych treningów. Powstała z zespołu akademickiego na USC, stopniowo ewoluowała w podstawowy produkt TensorOpera AI poprzez komercjalizację.

Dla badaczy i programistów, FedML zapewnia narzędzia do współpracy w zakresie treningu danych międzyinstytucjonalnych i między urządzeniami. W akademii, FedML stała się szeroko przyjętą platformą eksperymentalną dla badań FL, często pojawiając się na czołowych konferencjach, takich jak NeurIPS, ICML i AAAI. W przemyśle zyskała silną reputację w dziedzinach wrażliwych na prywatność, takich jak opieka zdrowotna, finanse, AI na krawędzi i AI Web3 — pozycjonując się jako benchmarkowe narzędzie dla uczenia federacyjnego.

TensorOpera reprezentuje skomercjalizowaną ewolucję FedML, ulepszoną w pełnostackową platformę infrastruktury AI dla przedsiębiorstw i programistów. Zachowując swoje możliwości uczenia federacyjnego, rozszerza się na rynki GPU, usługi modelowe i MLOps, a tym samym wchodzi na szerszy rynek ery LLM i agentów.

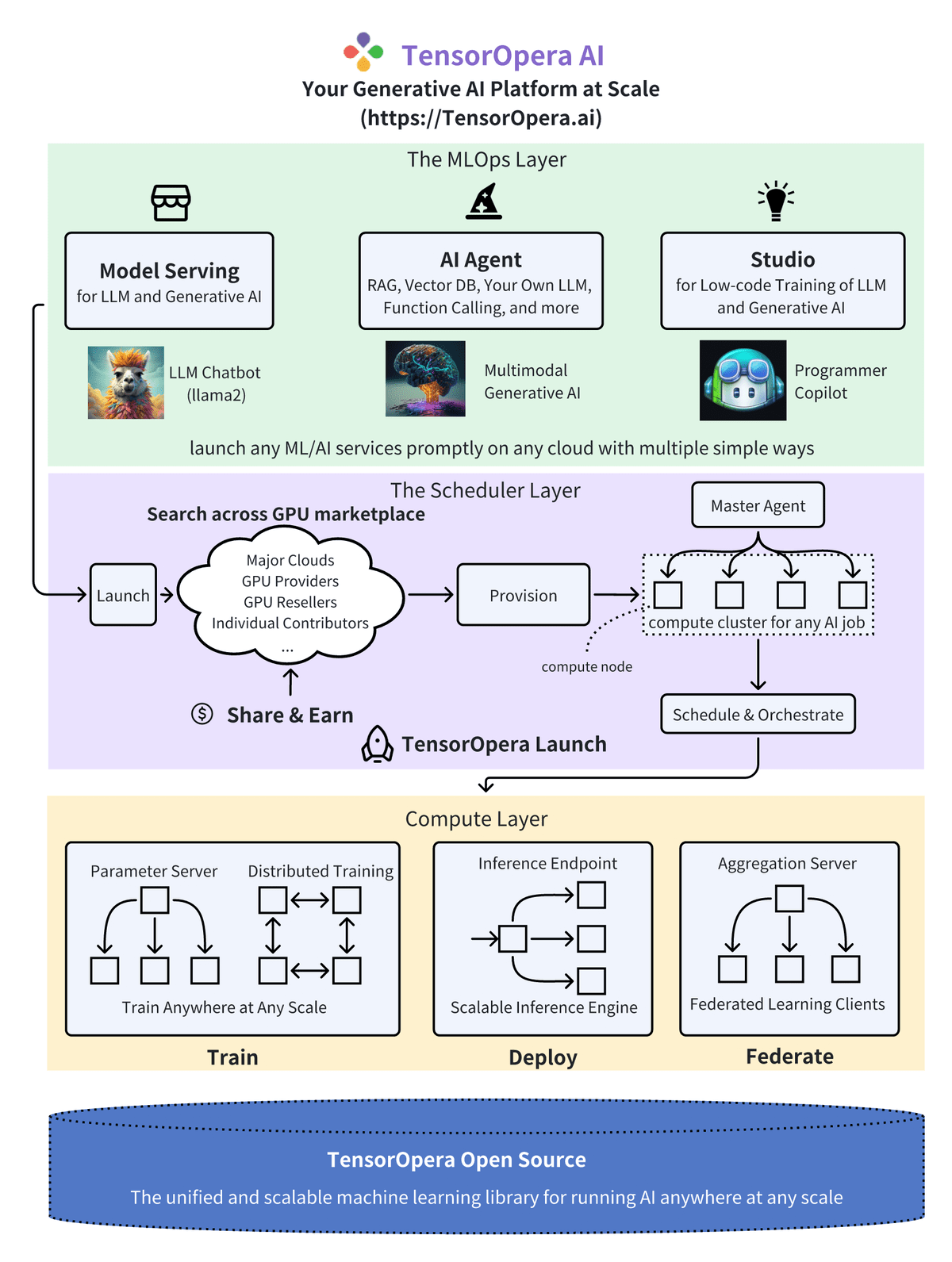

Cała architektura jest zorganizowana w trzy warstwy: Warstwa Obliczeń (podstawa), Warstwa Harmonogramu (koordynacja) i Warstwa MLOps (aplikacja).

Warstwa Obliczeń (Podstawa)

Warstwa Obliczeń stanowi techniczną podstawę TensorOpera, kontynuując otwarte DNA FedML.Funkcje podstawowe: Serwer Parametrów, Rozproszone Uczenie, Punkt Wnioskowania i Serwer Agregacji.

Propozycja wartości: Zapewnia rozproszone uczenie, uczenie federacyjne z zachowaniem prywatności i skalowalny silnik wnioskowania. Wspólnie te wspierają trzy podstawowe zdolności Trenuj / Wdrażaj / Federalizuj, obejmując pełną linię od treningu modeli do wdrażania i współpracy między instytucjami.

Warstwa Harmonogramu (Koordynacja)

Warstwa Harmonogramu działa jako rynek obliczeń i centrum harmonogramowania, składające się z rynku GPU, Provision, Głównego Agenta oraz modułów Harmonizuj i Orkiestruj.Możliwości: Umożliwia alokację zasobów w chmurach publicznych, dostawcach GPU i niezależnych wkładach.

Znaczenie: To oznacza kluczowy krok od FedML do TensorOpera — wspierając dużą skalę treningu i wnioskowania AI poprzez inteligentne harmonogramowanie i orkiestrację, obejmując ładunki LLM i generatywne AI.

Potencjał tokenizacji: Model "Udostępnij & Zarabiaj" pozostawia otwarty interfejs mechanizmu zachęt, pokazując kompatybilność z DePIN lub szerszymi modelami Web3.

Warstwa MLOps (Aplikacja)

Warstwa MLOps zapewnia bezpośrednie usługi dla programistów i przedsiębiorstw, w tym Serwisowanie Modeli, Agentów AI i moduły Studio.Aplikacje: chatboty LLM, multimodalna generatywna AI i narzędzia pilotażowe dla programistów.

Propozycja wartości: Abstrahuje niskopoziomowe możliwości obliczeniowe i treningowe w wysokopoziomowe API i produkty, obniżając barierę użycia. Oferuje gotowe do użycia agentów, środowiska niskokodowe i skalowalne rozwiązania wdrożeniowe.

Pozycjonowanie: Porównywalne z nowoczesnymi platformami infrastruktury AI, takimi jak Anyscale, Together i Modal — służąc jako most od infrastruktury do aplikacji.

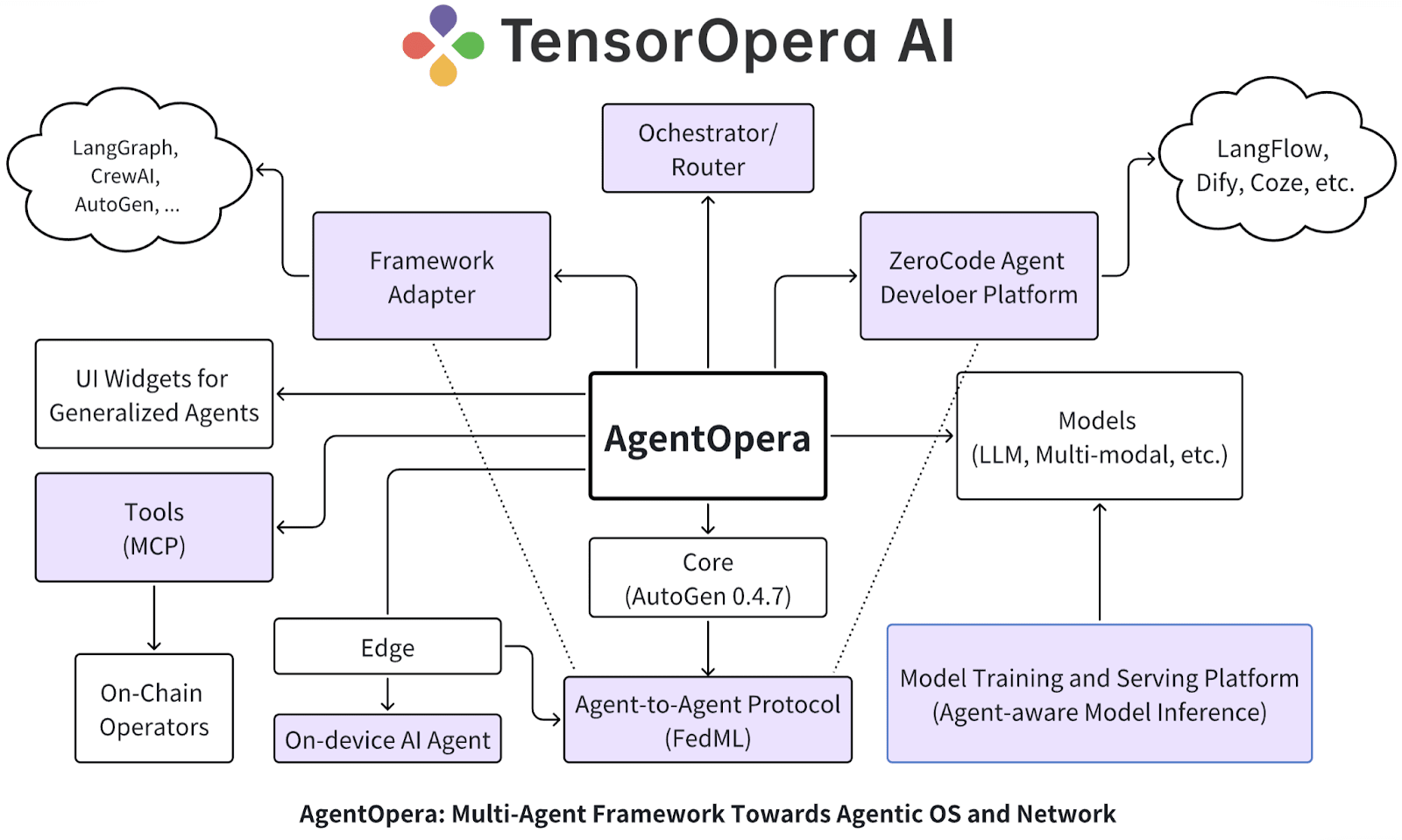

W marcu 2025 roku TensorOpera zaktualizowała się do pełnostackowej platformy ukierunkowanej na Agentów AI, z jej podstawowymi produktami obejmującymi Aplikację AgentOpera AI, Ramy i Platformę:

Warstwa Aplikacji: Oferuje punkty wejścia wieloagentowe podobne do ChatGPT.

Warstwa Ramowa: Ewoluuje w "Agentic OS" poprzez strukturalne systemy wieloagentowe i moduły Orkiestratora/Routa.

Warstwa Platformy: Głęboko integruje się z platformą modelu TensorOpera i FedML, umożliwiając rozproszone usługi modelowe, optymalizację RAG i hybrydowe wdrażanie na krawędzi i w chmurze.

Ogólna wizja to zbudowanie „jednego systemu operacyjnego, jednej sieci agentów”, umożliwiając programistom, przedsiębiorstwom i użytkownikom współtworzenie ekosystemu Agentic AI następnej generacji w otwartym i zachowującym prywatność środowisku.

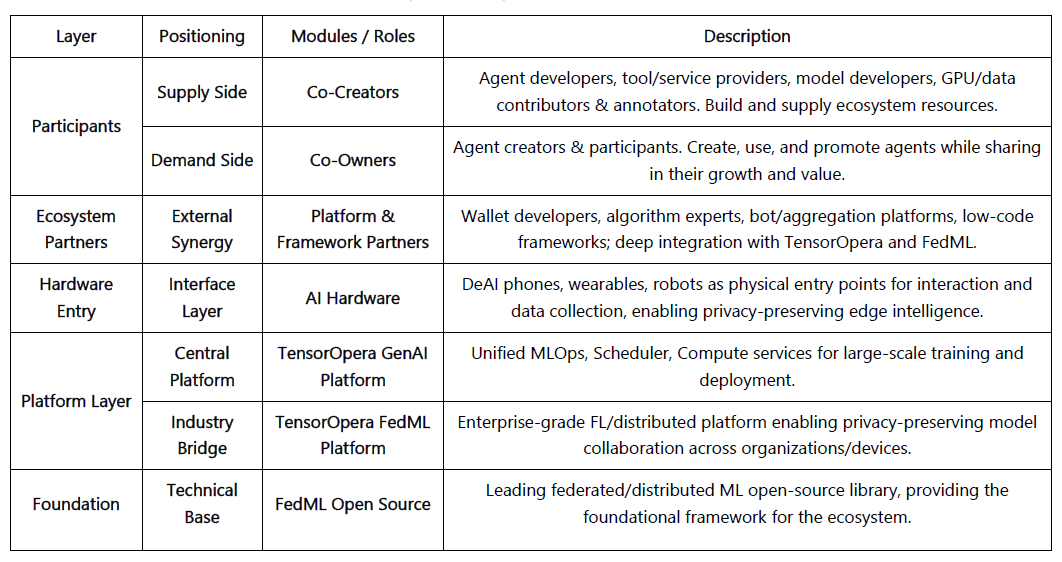

III. Ekosystem AI ChainOpera: Od Współtwórców i Współwłaścicieli do Technicznej Podstawy

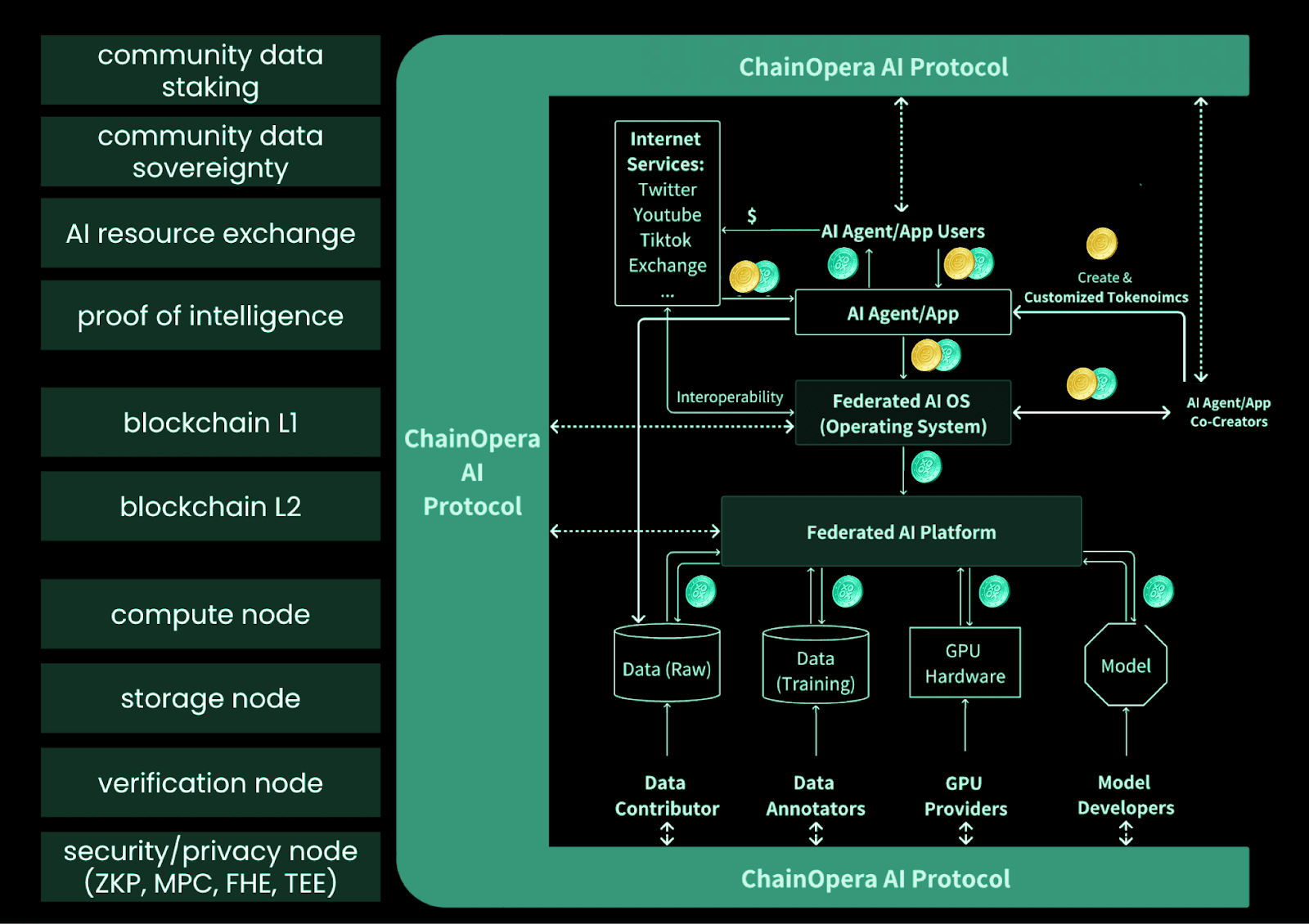

Jeśli FedML reprezentuje techniczne jądro, zapewniając otwarte podstawy uczenia federacyjnego i rozproszonego treningu; a TensorOpera abstrahuje wyniki badań FedML w skomercjalizowaną, pełnostackową infrastrukturę AI — to ChainOpera przenosi tę zdolność platformy na łańcuch.

Łącząc Terminale AI + Sieci Społecznościowe Agentów + warstwy obliczeń/danych oparte na DePIN + natywne blockchainy AI, ChainOpera dąży do zbudowania zdecentralizowanego ekosystemu sieci agentów.

Fundamentalna zmiana polega na tym, że podczas gdy TensorOpera pozostaje głównie ukierunkowana na przedsiębiorstwa i programistów, ChainOpera wykorzystuje mechanizmy zarządzania i zachęt w stylu Web3, aby włączyć użytkowników, programistów, dostawców GPU i wkłady danych jako współtwórców i współwłaścicieli. W ten sposób agenci AI są nie tylko "używani", ale także "współtworzeni i współposiadani".

Ekosystem Współtwórców

Poprzez swoją Platformę Modelu & GPU i Platformę Agenta, ChainOpera zapewnia narzędzia, infrastrukturę i warstwy koordynacji dla współpracy twórczej. Umożliwia to trening modeli, rozwój agentów, wdrażanie i współpracujące skalowanie.

Współtwórcy ekosystemu obejmują:

Programiści Agentów AI – projektują i obsługują agentów.

Dostawcy Narzędzi i Usług – szablony, MCP, bazy danych, API.

Programiści Modeli – trenują i publikują karty modeli.

Dostawcy GPU – przyczyniają się do mocy obliczeniowej poprzez DePIN lub partnerstwa w chmurze Web2.

Wkładcy Danych & Adnotatorzy – przesyłają i oznaczają multimodalne zbiory danych.

Razem te trzy filary — rozwój, obliczenia i dane — napędzają ciągły rozwój sieci agentów.

Ekosystem Współwłaścicieli

ChainOpera wprowadza również mechanizm współwłasności poprzez wspólne uczestnictwo w budowaniu sieci.

Twórcy Agentów AI (indywidualni lub zespoły) projektują i wdrażają nowe agenty za pośrednictwem Platformy Agenta, uruchamiając i utrzymując je, jednocześnie wprowadzając innowacje funkcjonalne i aplikacyjne.

Uczestnicy Agentów AI (ze społeczności) dołączają do cykli życia agentów, nabywając i przechowując Jednostki Dostępu, wspierając w ten sposób wzrost i aktywność agentów poprzez użycie i promocję.

Te dwie role reprezentują stronę podaży i popytu, tworząc model współdzielenia wartości i współrozwoju w ekosystemie.

Partnerzy Ekosystemu: Platformy i Ramy

ChainOpera szeroko współpracuje, aby zwiększyć użyteczność, bezpieczeństwo i integrację Web3:

Aplikacja Terminala AI łączy portfele, algorytmy i platformy agregacyjne, aby dostarczać inteligentne rekomendacje usług.

Platforma Agenta integruje narzędzia wieloramowe i niskokodowe, aby obniżyć barierę rozwoju.

TensorOpera AI napędza trening i wnioskowanie modelu.

FedML działa jako ekskluzywny partner, umożliwiając trening z zachowaniem prywatności w ramach współpracy międzyinstytucjonalnej i między urządzeniami.

Efektem jest otwarty ekosystem równoważący aplikacje klasy korporacyjnej z natywnymi doświadczeniami użytkownika Web3.

Punkty Dostępu Sprzętowego: Sprzęt AI & Partnerzy

Poprzez DeAI Telefony, urządzenia noszone i robotycznych partnerów AI, ChainOpera integruje blockchain i AI w inteligentnych terminalach. Te urządzenia umożliwiają interakcję z dApp, trening po stronie krawędzi i ochronę prywatności, stopniowo tworząc zdecentralizowany ekosystem sprzętu AI.

Centralne Platformy i Techniczna Podstawa

Platforma GenAI TensorOpera – zapewnia pełnostackowe usługi w zakresie MLOps, Harmonogramu i Obliczeń; wspiera trening i wdrażanie modeli na dużą skalę.

Platforma FedML TensorOpera – platforma uczenia federacyjnego/rozproszonego klasy korporacyjnej, umożliwiająca zachowanie prywatności w treningu między organizacjami/urządzeniami i służenie jako most między akademią a przemysłem.

FedML Open Source – wiodąca globalnie biblioteka uczenia federacyjnego/rozproszonego ML, służąca jako techniczna baza ekosystemu z zaufaną, skalowalną ramą otwartego źródła.

Struktura Ekosystemu AI ChainOpera

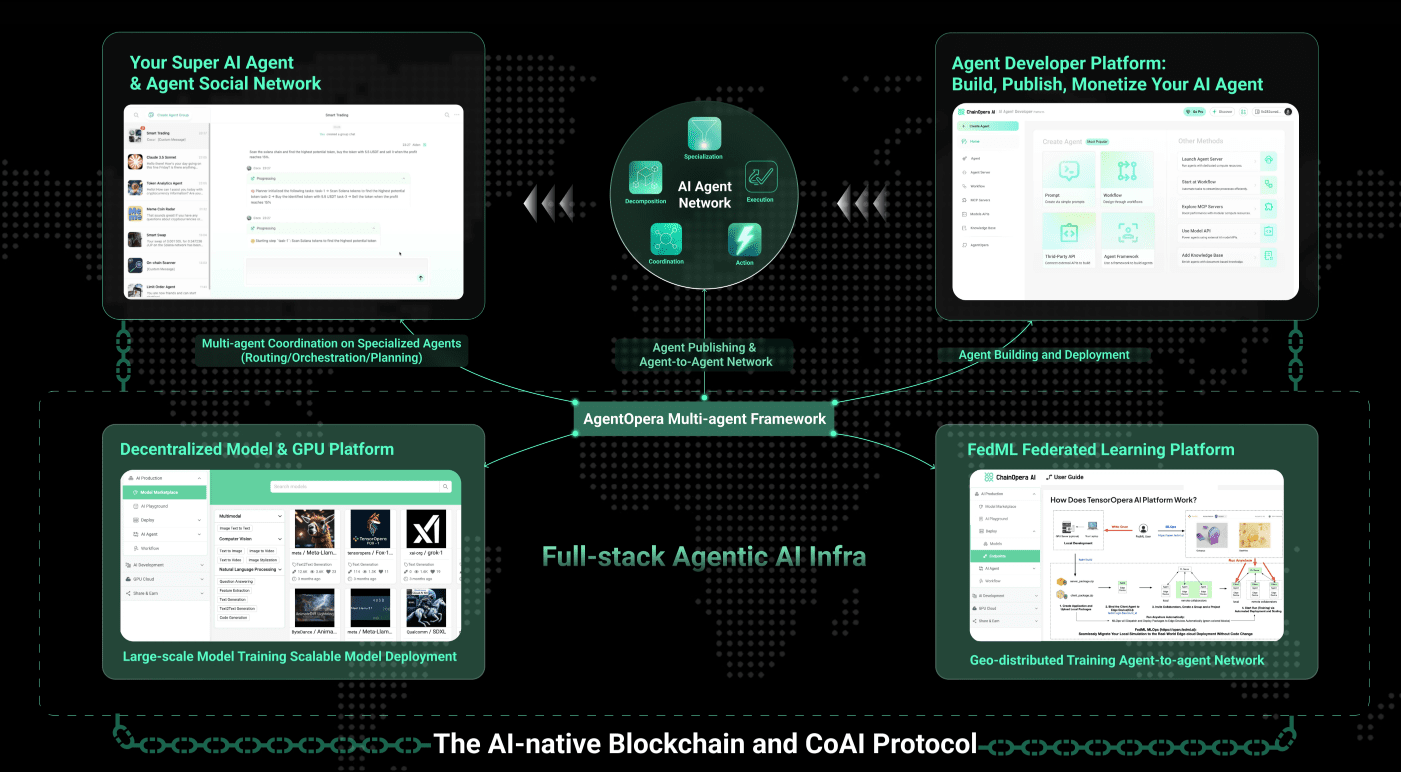

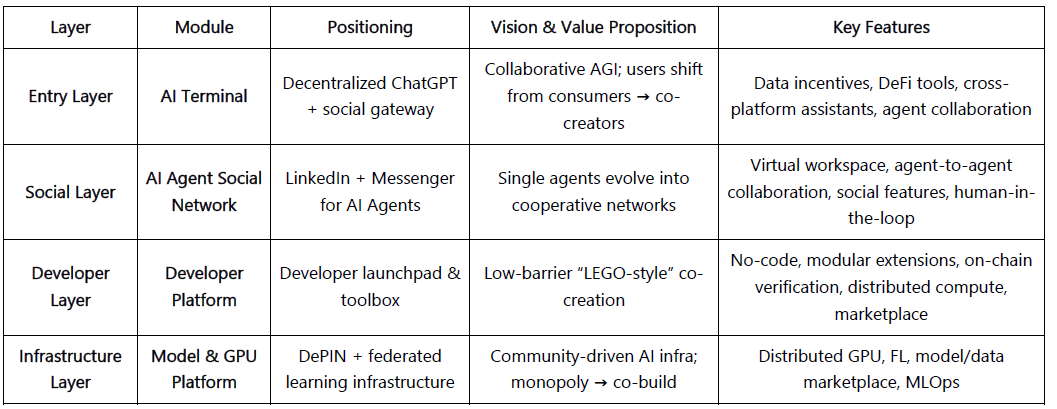

IV. Podstawowe Produkty ChainOpera i Pełnostackowa Infrastruktura AI Agentów

W czerwcu 2025 roku ChainOpera oficjalnie uruchomiła swoją aplikację Terminal AI i zdecentralizowany stos technologiczny, pozycjonując się jako "Zdecentralizowany OpenAI." Jej podstawowe produkty obejmują cztery moduły:

Warstwa Aplikacji – Terminal AI & Sieć Agentów

Warstwa Dewelopera – Centrum Twórców Agentów

Warstwa Modelu & GPU – Sieć Modeli & Obliczeń

Protokół CoAI & Dedykowany Łańcuch

Razem te moduły obejmują pełną pętlę od punktów wejścia użytkownika po podstawowe obliczenia i zachęty on-chain.

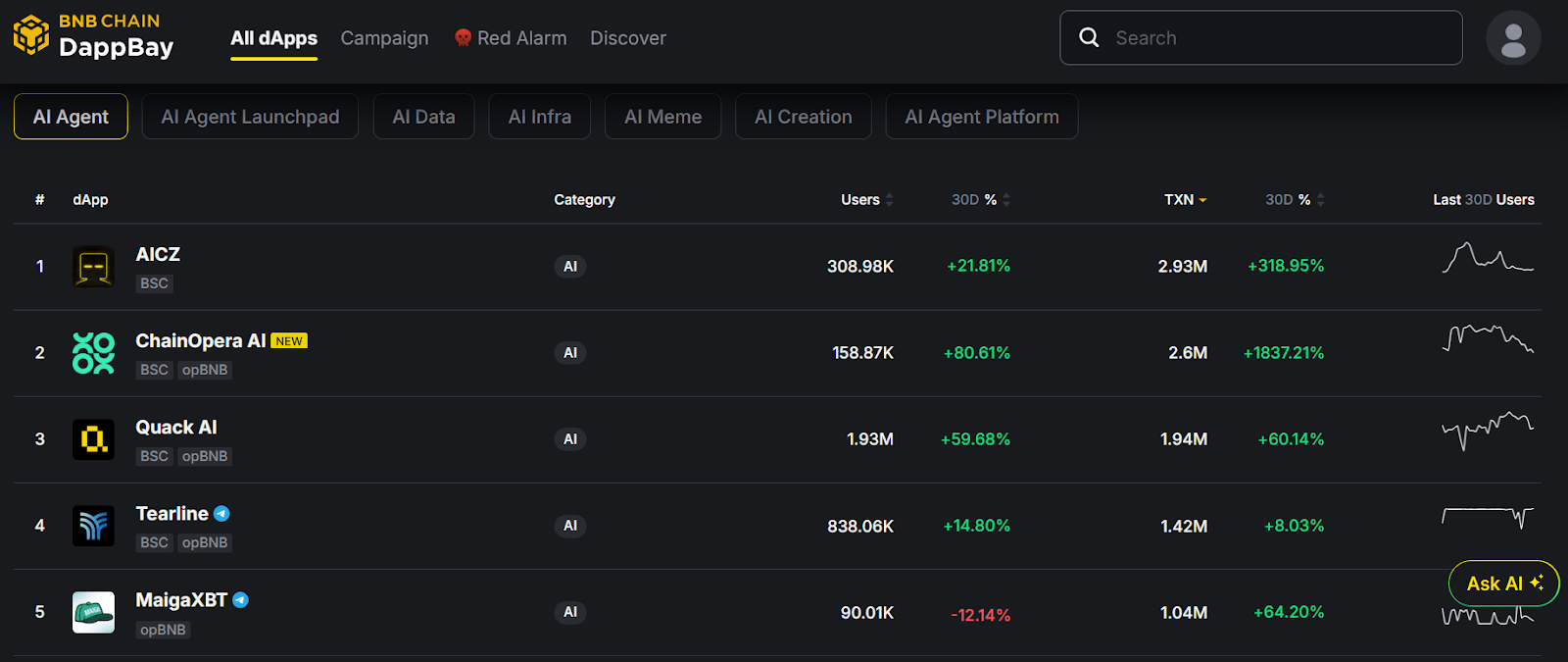

Aplikacja Terminala AI

Już zintegrowane z BNB Chain, Terminal AI wspiera transakcje on-chain i agentów natywnych DeFi. Centrum Twórców Agentów jest otwarte dla programistów, oferując MCP/HUB, bazę wiedzy i możliwości RAG, z ciągłym wprowadzaniem agentów stworzonych przez społeczność. W międzyczasie, ChainOpera uruchomiła CO-AI Alliance, współpracując z io.net, Render, TensorOpera, FedML i MindNetwork.

Według danych on-chain BNB DApp Bay (ostatnie 30 dni): 158,87K unikalnych użytkowników, 2,6M transakcji i 2. miejsce w całej kategorii „AI Agent” na BSC, co pokazuje silną i rosnącą aktywność on-chain.

Super Aplikacja Agenta AI – Terminal AI 👉 chat.chainopera.ai

Pozycjonowana jako zdecentralizowany ChatGPT + Hub Społecznościowy AI, Terminal AI oferuje: Współpraca multimodalna, Zachęty do wkładu danych, Integracja narzędzi DeFi, Wsparcie międzyplatformowe, Współpraca agentów z zachowaniem prywatności (Twoje dane, Twój agent). Użytkownicy mogą bezpośrednio wywoływać model DeepSeek-R1 z otwartym źródłem i agentów stworzonych przez społeczność z urządzeń mobilnych. Podczas interakcji, zarówno tokeny językowe, jak i tokeny kryptograficzne krążą przejrzyście na łańcuchu.

Wartość podstawowa: przekształca użytkowników z "konsumentów treści" w "inteligentnych współtwórców." Stosowne w DeFi, RWA, PayFi, e-commerce i innych dziedzinach za pośrednictwem spersonalizowanych sieci agentów.

Sieć Społecznościowa Agentów AI 👉 chat.chainopera.ai/agent-social-network

Wyobrażone jako LinkedIn + Messenger dla Agentów AI. Oferuje wirtualne miejsca pracy i mechanizmy współpracy Agent-do-Agenta (MetaGPT, ChatDEV, AutoGEN, Camel). Ewaluuje pojedyncze agenty w współpracujące sieci wieloagentowe obejmujące finanse, gry, e-commerce i badania. Stopniowo zwiększa pamięć i autonomię.

Platforma Dewelopera Agentów AI👉 agent.chainopera.ai

Zaprojektowane jako doświadczenie tworzenia w stylu "LEGO" dla programistów. Wspiera brak kodu i modułowe rozszerzenia, Inteligentne kontrakty blockchain zapewniają prawa własności, DePIN + infrastruktura chmurowa obniżają bariery wejścia, a Rynek umożliwia odkrycie i dystrybucję.

Wartość podstawowa: umożliwia programistom szybkie dotarcie do użytkowników, a wkłady są przejrzysto rejestrowane i nagradzane.

Model AI & GPU Platform 👉 platform.chainopera.ai

Służąc jako warstwa infrastruktury, łączy DePIN i uczenie federacyjne, aby zaspokoić zależność AI Web3 od zcentralizowanego obliczenia. Możliwości obejmują: Rozproszoną sieć GPU, Szkolenie danych z zachowaniem prywatności, Rynek modeli i danych, End-to-end MLOps.

Wizja: przesunięcie z "monopolu wielkiej technologii" na "infrastrukturę napędzaną przez społeczność" — umożliwiająca współpracę wielu agentów i spersonalizowaną sztuczną inteligencję.

Ogólny przegląd architektury pełnostackowej ChainOpera

V. ChainOpera AI Plan Działania

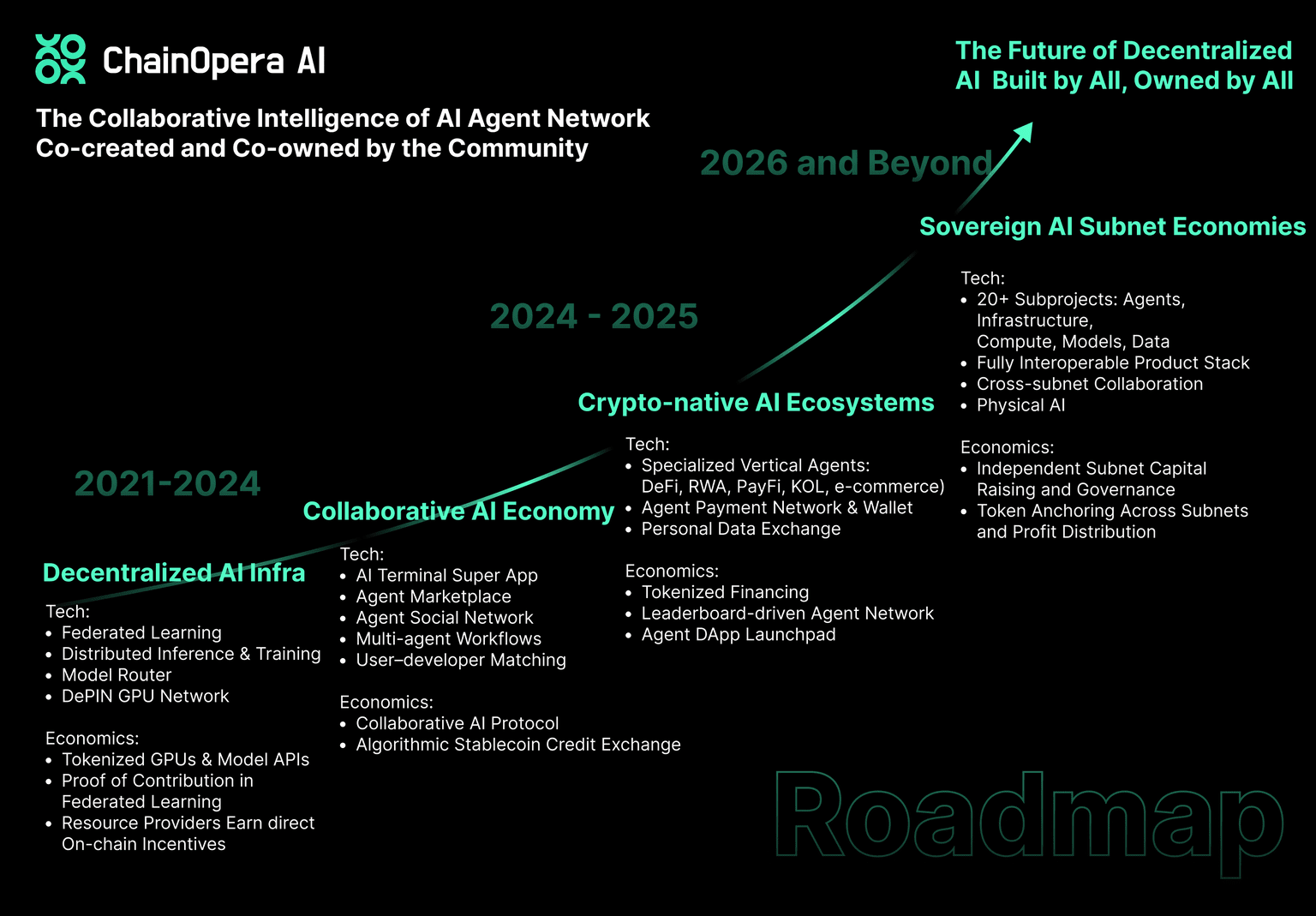

Poza już uruchomioną pełnostackową platformą Agentów AI, ChainOpera AI ma mocne przekonanie, że Sztuczna Ogólna Inteligencja (AGI) wyłoni się z multimodalnych, wieloagentowych sieci współpracy. Jej długoterminowy plan działania jest podzielony na cztery fazy:

Faza I (Obliczenia → Kapitał):

Budowanie zdecentralizowanej infrastruktury: sieci DePIN GPU, uczenie federacyjne, platformy treningu/wnioskowania rozproszonego.

Wprowadzenie Routera Modelu do koordynacji wielokrotnych wniosków.

Zachęcanie dostawców obliczeń, modeli i danych poprzez podział przychodów na podstawie wykorzystania.

Faza II (Aplikacje Agentów → Zdecentralizowana Gospodarka AI):

Uruchomienie Terminala AI, Rynku Agentów i Sieci Społecznościowej Agentów, tworząc ekosystem aplikacji wieloagentowych.

Wdrożenie Protokółu CoAI, aby połączyć użytkowników, programistów i dostawców zasobów.

Wprowadzenie dopasowania użytkowników i programistów oraz systemu kredytowego, umożliwiającego częste interakcje i zrównoważoną aktywność gospodarczą.

Faza III (Współpraca AI → AI Natywne Kryptowaluty):

Rozszerzenie na scenariusze DeFi, RWA, płatności i e-commerce.

Rozszerzenie na przypadki użycia napędzane przez KOL i wymianę danych osobowych.

Rozwój LLM skoncentrowanych na finansach/kryptowalutach i uruchomienie płatności Agent-do-Agenta oraz systemów portfeli, odblokowując aplikacje "Crypto AGI".

Faza IV (Ekosystemy → Zdecentralizowane Gospodarki AI):

Ewolucja w kierunku autonomicznych gospodarek subnetów, z każdym subnetem specjalizującym się w aplikacjach, infrastrukturze, obliczeniach, modelach lub danych.

Umożliwienie zarządzania subnetem i tokenizowanych operacji, podczas gdy protokoły między subnetami wspierają interoperacyjność i współpracę.

Rozszerzenie z Agentic AI do AI Fizycznej (robotyka, autonomiczne prowadzenie, lotnictwo).

Zastrzeżenie: Ten plan działania ma charakter wyłącznie informacyjny. Harmonogramy i funkcjonalności mogą dynamicznie dostosowywać się do warunków rynkowych i nie stanowią gwarancji dostawy.

VI. Zachęty Tokenowe i Zarządzanie Protokolem

ChainOpera jeszcze nie wydała pełnego planu zachęt tokenów, ale jej Protokół CoAI koncentruje się na "współtworzeniu i współwłasności." Wkłady są przejrzysto rejestrowane i weryfikowalne za pośrednictwem blockchaina i mechanizmu Dowodu Inteligencji (PoI). Programiści, dostawcy obliczeń, wkładcy danych i dostawcy usług są wynagradzani na podstawie standardowych metryk wkładu. Użytkownicy konsumują usługi. Dostawcy zasobów utrzymują operacje. Programiści budują aplikacje. Wszyscy uczestnicy dzielą się dywidendami wzrostu ekosystemu. Platforma utrzymuje się dzięki 1% opłaty za usługi, nagrodom za alokację i wsparciu płynności — budując otwarty, uczciwy i współpracujący zdecentralizowany ekosystem AI.

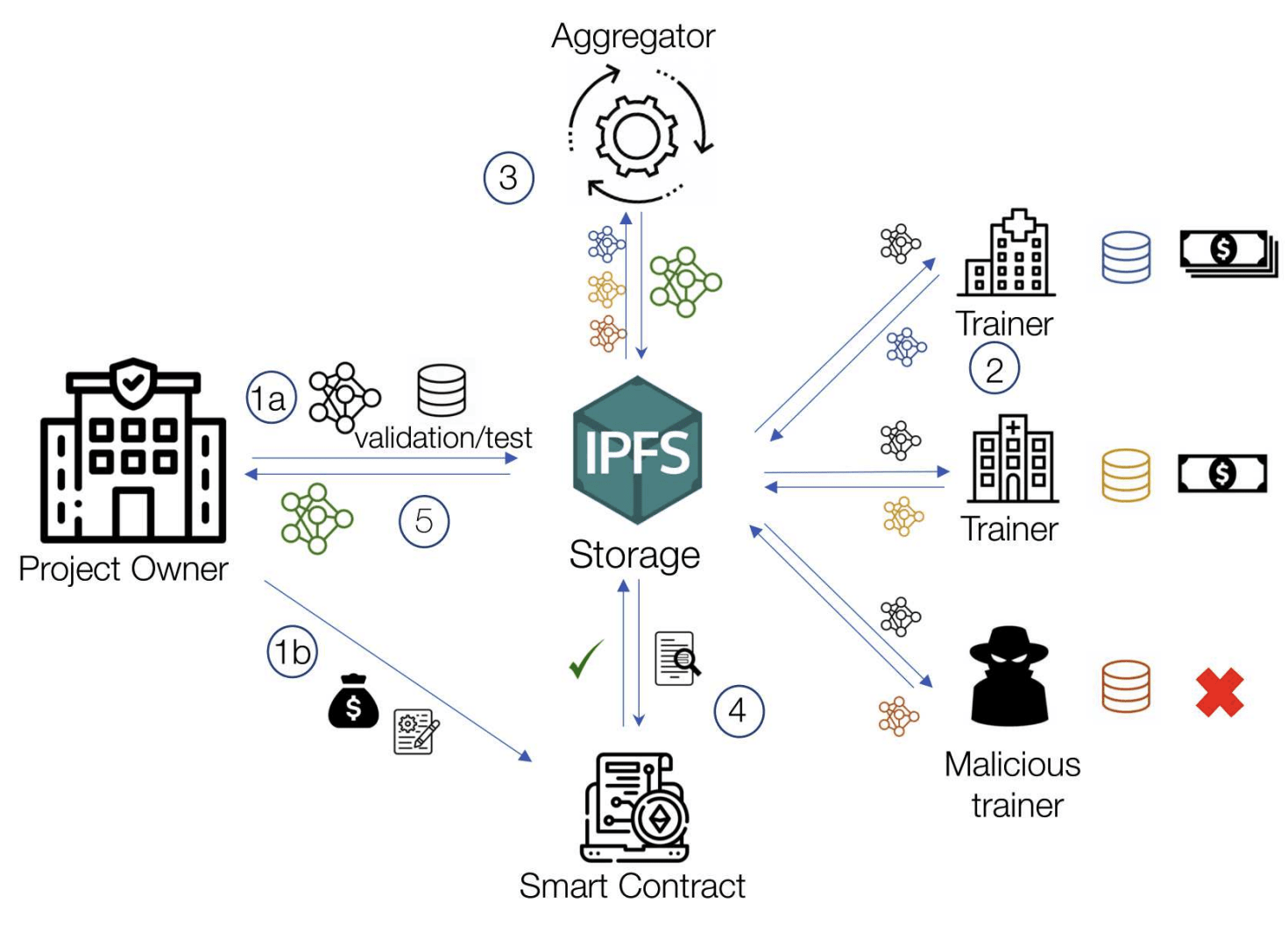

Ramowy Dowód Inteligencji (PoI)

PoI jest podstawowym mechanizmem konsensusu ChainOpera w ramach Protokółu CoAI, zaprojektowanym w celu ustanowienia przejrzystego, uczciwego i weryfikowalnego systemu zachęt i zarządzania dla zdecentralizowanej AI. Rozszerza Dowód Wkładu na blockchainowy, współpracujący framework uczenia maszynowego, rozwiązując trwałe problemy uczenia federacyjnego: niewystarczające zachęty, ryzyka prywatności i brak weryfikowalności.

Podstawowy projekt:

Osadzone w inteligentnych kontraktach, zintegrowane z zdecentralizowanym magazynem (IPFS), węzłami agregacyjnymi i dowodami zerowej wiedzy (zkSNARKs).

Osiąga pięć kluczowych celów:

Sprawiedliwe nagrody oparte na wkładzie, zapewniające, że trenerzy są wynagradzani za rzeczywiste poprawy modelu.

Dane pozostają lokalne, zapewniając ochronę prywatności.

Mechanizmy odporności na złośliwych uczestników (trucizna, ataki agregacyjne).

Weryfikacja ZKP dla krytycznych procesów: agregacja modelu, wykrywanie anomalii, ocena wkładu.

Wydajność i ogólność w przypadkuheterogenicznych danych i różnorodnych zadań uczenia.

Przepływy Wartości Tokenów w Pełnostackowym AI

Projekt tokena ChainOpera opiera się na użyteczności i uznawaniu wkładu, a nie spekulacji. Kręci się wokół pięciu głównych strumieni wartości:

LaunchPad – do inicjacji agentów/aplikacji.

API Agenta – dostęp do usług i integracja.

Serwisowanie Modelu – opłaty za wnioskowanie i wdrażanie.

Wkład – adnotacja danych, dzielenie się obliczeniami lub wkład w usługi.

Trening Modelu – rozproszone zadania treningowe.

Interesariusze:

Użytkownicy AI – wydają tokeny na dostęp do usług lub subskrypcję aplikacji; przyczyniają się poprzez dostarczanie/oznaczanie/stakowanie danych.

Programiści Agentów & Aplikacji – używają obliczeń/danych do rozwoju; nagradzani za wkład w agentów, aplikacje lub zbiory danych.

Dostawcy Zasobów – przyczyniają się do obliczeń, danych lub modeli; nagradzani w sposób przejrzysty.

Uczestnicy Zarządzania (Społeczność i DAO) – używają tokenów do głosowania, kształtowania mechanizmów i koordynowania ekosystemu.

Warstwa Protokołu (CoAI) – wspiera rozwój poprzez opłaty za usługi i automatyczne równoważenie podaży/popytu.

Węzły i Walidatory – zabezpieczają sieć, dostarczając usługi walidacji, obliczeń i bezpieczeństwa.

Zarządzanie Protokolem

ChainOpera przyjmuje zarządzanie oparte na DAO, gdzie stakowanie tokenów umożliwia udział w propozycjach i głosowaniach, zapewniając przejrzystość i uczciwość.

Mechanizmy zarządzania obejmują:

System Reputacji – weryfikuje i kwantyfikuje wkłady.

Współpraca Społeczności – propozycje i głosowanie napędzają ewolucję ekosystemu.

Dostosowania Parametrów – obejmujące wykorzystanie danych, bezpieczeństwo i odpowiedzialność walidatorów.

Ogólny cel: zapobiegać koncentracji władzy, zapewnić stabilność systemu i utrzymać współtworzenie społeczności.

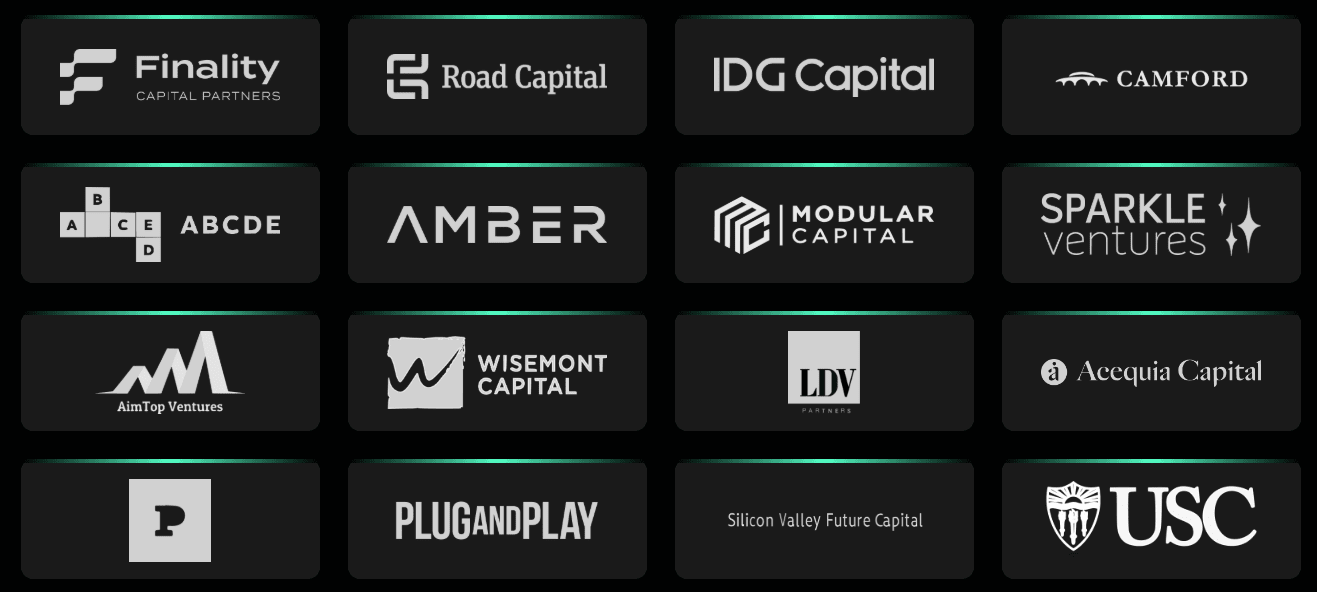

VIII. Tło Zespołu i Finansowanie Projektu

Projekt ChainOpera został współzałożony przez Profesora Salmana Avestimehra, czołowego badacza w dziedzinie uczenia federacyjnego, oraz Dr. Aidena Chaoyang He. Zespół główny obejmuje tło akademickie i przemysłowe z instytucji takich jak UC Berkeley, Stanford, USC, MIT, Uniwersytet Tsinghua oraz liderów technologicznych, w tym Google, Amazon, Tencent, Meta i Apple. Zespół łączy głęboką wiedzę badawczą z rozległymi możliwościami wykonawczymi w przemyśle i urósł do ponad 40 członków do tej pory.

Współzałożyciel: Profesor Salman Avestimehr

Tytuł & Role: Profesor Dziekan Wydziału Elektrycznego & Inżynierii Komputerowej na Uniwersytecie Południowej Kalifornii (USC), Dyrektor założycielski USC-Amazon Center on Trusted AI oraz kierownik laboratorium vITAL (Teoria Informacji & Uczenie Maszynowe) na USC.

Przedsiębiorczość: Współzałożyciel & CEO FedML, a w 2022 roku współzałożył TensorOpera/ChainOpera AI.

Edukacja & Wyróżnienia: Ph.D. w EECS na UC Berkeley (Nagroda za Najlepszą Pracę Doktorska). Członek IEEE z ponad 300 publikacjami w teorii informacji, obliczeniach rozproszonych i uczeniu federacyjnym, cytowanymi ponad 30 000 razy. Otrzymał PECASE, Nagrodę NSF CAREER oraz Nagrodę IEEE Massey, między innymi.

Wkład: Twórca otwartej ramy FedML, szeroko przyjętej w opiece zdrowotnej, finansach i sztucznej inteligencji z zachowaniem prywatności, która stała się podstawą dla TensorOpera/ChainOpera AI.

Współzałożyciel: Dr. Aiden Chaoyang He

Tytuł & Role: Współzałożyciel & Prezydent TensorOpera/ChainOpera AI; Ph.D. w Informatyce z USC; oryginalny twórca FedML.

Skupienie badawcze: Rozproszone & federacyjne uczenie, trening modeli na dużą skalę, blockchain i obliczenia z zachowaniem prywatności.

Doświadczenie w przemyśle: Wcześniej pełnił role R&D w Meta, Amazon, Google, Tencent; służył w kluczowych rolach inżynieryjnych i zarządzających w Tencent, Baidu i Huawei, prowadząc wdrożenie wielu produktów i platform AI na skalę internetową.

Wpływ akademicki: Opublikował ponad 30 prac z ponad 13 000 cytowaniami na Google Scholar. Otrzymał Stypendium Doktoranckie Amazon, Stypendium Innowacji Qualcomm oraz Nagrodę za Najlepszą Pracę na NeurIPS i AAAI.

Wkłady techniczne: Kierował rozwojem FedML, jednej z najczęściej używanych otwartoźródłowych ram w uczeniu federacyjnym, obsługującej 27 miliardów codziennych zapytań.Główny wkład w FedNLP oraz metody hybrydowego równoległego uczenia, stosowane w zdecentralizowanych projektach AI, takich jak Sahara AI..

W grudniu 2024 roku ChainOpera AI ogłosiła zakończenie rundy seedowej w wysokości 3,5 mln USD, co podniosło całkowite finansowanie (w połączeniu z TensorOpera) do 17 mln USD. Fundusze zostaną przeznaczone na budowę blockchaina warstwy 1 i systemu operacyjnego AI dla zdecentralizowanych agentów AI.

Główni Inwestorzy: Finality Capital, Road Capital, IDG Capital

Inni Uczestnicy: Camford VC, ABCDE Capital, Amber Group, Modular Capital

Strategiczni Wspierający: Sparkle Ventures, Plug and Play, USC

Znani Inwestorzy Indywidualni: Sreeram Kannan, założyciel EigenLayer i David Tse, współzałożyciel BabylonChain

Zespół stwierdził, że ta runda przyspieszy jego wizję tworzenia zdecentralizowanego ekosystemu AI, w którym dostawcy zasobów, programiści i użytkownicy współwłasność i współtworzą.

IX. Analiza Krajobrazu Rynkowego: Uczenie Federacyjne i Sieci Agentów AI

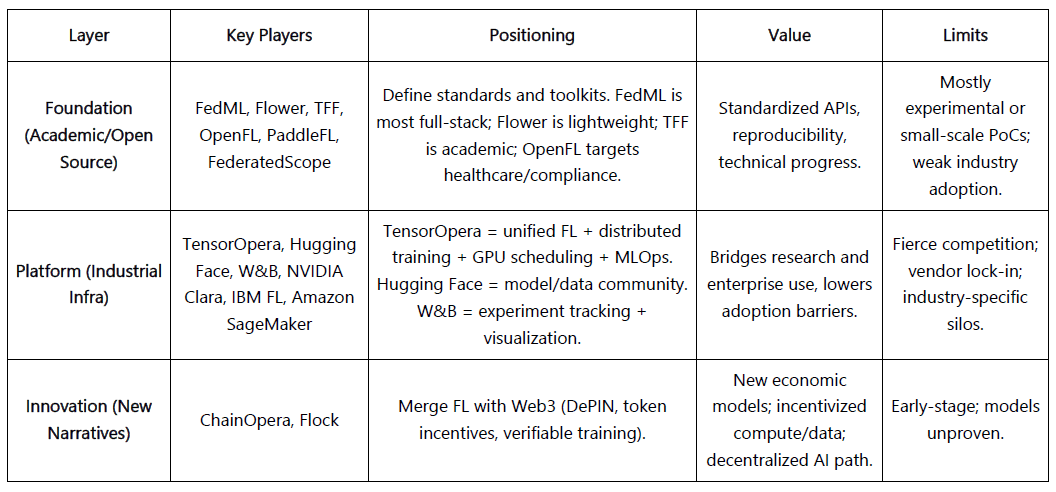

Krajobraz Uczenia Federacyjnego

Pole uczenia federacyjnego (FL) kształtowane jest przez cztery główne ramy. FedML jest najbardziej kompleksowy, łącząc FL, rozproszone uczenie dużych modeli i MLOps, co czyni go gotowym do zastosowania w przedsiębiorstwach. Flower jest lekki i szeroko stosowany w nauczaniu oraz małych eksperymentach. TFF (TensorFlow Federated) jest cenny akademicko, ale słaby w industrializacji. OpenFL celuje w opiekę zdrowotną i finanse, z silnymi cechami zgodności, ale zamkniętym ekosystemem. Krótko mówiąc: FedML to przemysłowy wszechstronny, Flower podkreśla łatwość użycia, TFF pozostaje akademicki, a OpenFL wyróżnia się w zgodności wertykalnej.

Platformy i Infrastruktura Przemysłowa

TensorOpera, skomercjalizowana ewolucja FedML, integruje planowanie GPU w chmurze, rozproszone uczenie, uczenie federacyjne i MLOps w zintegrowanym stosie. Pozycjonowana jako most między badaniami a przemysłem, służy programistom, MŚP i ekosystemom Web3/DePIN. Efektywnie, TensorOpera jest jak “Hugging Face + W&B” dla uczenia federacyjnego i rozproszonego, oferując bardziej kompletną i uniwersalną platformę niż alternatywy skoncentrowane na narzędziach lub sektorach.

Warstwa Innowacji: ChainOpera vs. Flock

ChainOpera i Flock łączą FL z Web3, ale różnią się w podejściu. ChainOpera buduje pełnostackową platformę agenta AI, przekształcając użytkowników w współtwórców poprzez Terminal AI i Sieć Społecznościową Agentów. Flock koncentruje się na Uczeniu Federacyjnym wspomaganym przez Blockchain (BAFL), podkreślając prywatność i zachęty na warstwie obliczeń i danych. Mówiąc prościej: ChainOpera podkreśla aplikacje i sieci agentów, podczas gdy Flock koncentruje się na niskopoziomowym treningu i obliczeniach z zachowaniem prywatności.

Krajobraz Uczenia Federacyjnego & Infrastruktura AI

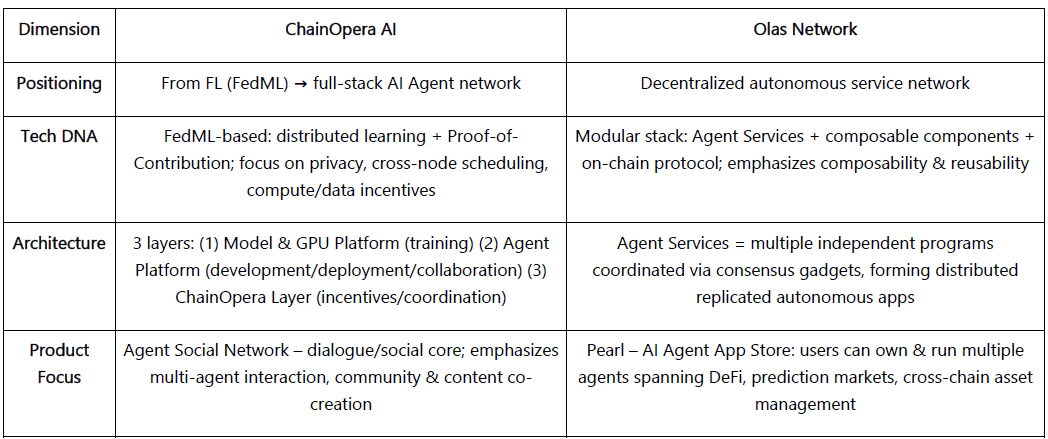

Warstwa Sieci Agentów: ChainOpera vs. Olas

Na poziomie sieci agentów, najbardziej reprezentatywne projekty to ChainOpera i Olas Network.

ChainOpera: zakorzeniona w uczeniu federacyjnym, buduje pełnostackową pętlę obejmującą modele, obliczenia i agentów. Jej Sieć Społecznościowa Agentów działa jako laboratorium do interakcji wieloagentowych i społecznej współpracy.

Sieć Olas (Autonolas / Pearl): powstała z współpracy DAO i ekosystemu DeFi, pozycjonowana jako zdecentralizowana sieć usług autonomicznych. Dzięki Pearl dostarcza aplikacje DeFi bezpośrednio na rynek — pokazując bardzo różną trajektorię od ChainOpera.

X. Teza Inwestycyjna i Analiza Ryzyka

Teza Inwestycyjna

Techniczna przewaga: Siła ChainOpera leży w jej unikalnej ścieżce ewolucji: z FedML (benchmarkowa otwartoźródłowa rama dla uczenia federacyjnego) → TensorOpera (pełnostackowa infrastruktura AI klasy korporacyjnej) → ChainOpera (sieci agentów wspomagane przez Web3 + DePIN + tokenomika). Ta trajektoria integruje podstawy akademickie, wdrożenia przemysłowe i narracje natywne dla kryptowalut, tworząc wyróżniającą się przewagę.

Aplikacje & Skala Użytkowników: Terminal AI osiągnął już setki tysięcy codziennych aktywnych użytkowników i rozwijający się ekosystem 1000+ aplikacji agentów. Zajmuje 1. miejsce w kategorii AI na BNBChain DApp Bay, co pokazuje wyraźny wzrost użytkowników on-chain i weryfikowalną aktywność transakcyjną. Jego multimodalne scenariusze, początkowo zakorzenione w zastosowaniach natywnych dla kryptowalut, mają potencjał do stopniowego rozszerzenia na szerszą bazę użytkowników Web2.

Partnerstwa Ekosystemu: ChainOpera uruchomiła CO-AI Alliance, współpracując z io.net, Render, TensorOpera, FedML i MindNetwork, aby zbudować efekty sieciowe po obu stronach GPU, modeli, danych i obliczeń z zachowaniem prywatności. Równocześnie, współpraca z Samsung Electronics w celu walidacji multimodalnej GenAI na urządzeniach mobilnych pokazuje potencjał do rozszerzenia w kierunku sprzętu i AI na krawędzi.

Model Tokenowy & Ekonomiczny: Tokenomika ChainOpera opiera się na konsensusie Dowodu Inteligencji, z zachętami rozdzielanymi na pięć strumieni wartości: LaunchPad, API Agenta, Serwisowanie Modeli, Wkład i Trening Modeli. Opłata serwisowa na poziomie 1%, alokacja nagród i wsparcie płynności tworzą pozytywną pętlę sprzężenia zwrotnego, unikając polegania na czystej "spekulacji tokenowej" i zwiększając zrównoważoność.

Potencjalne Ryzyka

Ryzyka związane z wykonaniem technicznym: Proponowana przez ChainOpera pięciowarstwowa zdecentralizowana architektura obejmuje szeroki zakres. Koordynacja międzywarstwowa — zwłaszcza w rozproszonym wnioskowaniu dla dużych modeli i treningu z zachowaniem prywatności — nadal napotyka wyzwania dotyczące wydajności i stabilności i nie została jeszcze zweryfikowana w skali.

Przywiązanie użytkowników i ekosystemu: Choć wczesny wzrost użytkowników jest znaczący, pozostaje pytanie, czy Rynek Agentów i narzędzia dla programistów mogą utrzymać długoterminową aktywność i wysokiej jakości wkłady. Obecna Sieć Społecznościowa Agentów jest głównie napędzana przez dialog tekstowy LLM; doświadczenie użytkownika i zatrzymywanie użytkowników wciąż wymagają poprawy. Bez starannie zaprojektowanych zachęt, ekosystem ryzykuje krótkoterminowym hype'm bez długoterminowej wartości.

Zrównoważoność modelu biznesowego: Obecnie przychody głównie zależą od opłat serwisowych platformy i obiegu tokenów; stabilne przepływy pieniężne jeszcze nie zostały ustanowione. W porównaniu do AgentFi lub aplikacji skoncentrowanych na płatnościach, które mają silniejsze atrybuty finansowe lub produktywnościowe, obecny model ChainOpera wymaga jeszcze dalszej weryfikacji swojej wartości komercyjnej. Dodatkowo, ekosystem mobilny i sprzętowy pozostaje w fazie eksperymentalnej, co pozostawia jego perspektywy rynkowe niepewne.

Zastrzeżenie: Ten raport został przygotowany z pomocą narzędzi AI (ChatGPT-5). Autor dołożył wszelkich starań, aby sprawdzić i zapewnić dokładność, ale mogą pozostać pewne błędy lub pominięcia. Czytelnicy powinni zauważyć, że rynki aktywów kryptograficznych często wykazują rozbieżności między podstawami projektów a wydajnością tokenów na rynku wtórnym. Raport ten ma na celu jedynie konsolidację informacji oraz dyskusję akademicką/badawczą. Nie stanowi porady inwestycyjnej ani nie powinien być interpretowany jako rekomendacja zakupu lub sprzedaży jakiegokolwiek tokena.